智源学者成果展示——机器学习方向

发布时间:2020-07-08

发布时间:2020-07-08

信息来源:北京智源人工智能研究院网站

字体:

大

中

小

信息来源:北京智源人工智能研究院网站

字体:

大

中

小

打印

打印

发布时间:2020-07-08

发布时间:2020-07-08

信息来源:北京智源人工智能研究院网站

信息来源:北京智源人工智能研究院网站

项目负责人:颜水成

Drop an Octave: Reducing Spatial Redundancy in Convolutional Neural Networks with Octave Convolution. ICCV-2019

自然图像中的信息是由不同频率的信号所构成, 那些在空间上变换剧烈的细节与纹理等通常是由高频信号构成,而变化缓慢的结构与全局信息则是由低频信号构成。同样,在卷积神经网络中,卷积层中的特征图也可以看作是由不同频率的信号所构成的。在这项工作中,我们提出对卷积层中的特征按频率分解,并为此设计了一种新的算子,称为八分音符卷积 (OctConv),目的是通过将变化缓慢的低频信号存储在分辨率较低的特征图中来减少空间冗余和计算开销,来更有效的处理不同频段的信息。不同于以往的多尺度的方法,八分音符卷积是一个即插即用的通用卷积算子,可以替换现有网络中的卷积层,并且无需修改网络结构。同一般卷积一样,八分音符卷积也可以使用“分组卷积”以及“深度卷积”等技术来进一步减少特征图之间的链接以达到稀疏和加速的目的。

实验证明,在二维图像识别以及三维视频分析中,八分音符卷积均可以稳定有效的提升卷积神经网络的识别精度并明显减少显存占用与计算开销。在ImageNet标准测试集上,八分音符卷积改造后的ResNet-152仅用22.2 GFLOPs 就达到了82.9%的高识别率。

项目负责人:林宙辰

《On the Convergence of Learning-based Iterative Methods for Nonconvex Inverse Problems》,该论文针对常见的反问题模型:

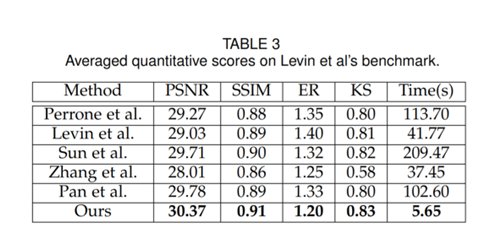

提出了基于学习的前向-后向分裂优化算法,并证明了算法的收敛性。在去模糊、去CONFERENCE雨等图像处理问题上取得了优异的效果,并显著提高了求解速度。下表是部分实验结果,展示了量化指标的提升和计算时间的显著减少:

基于学习的优化是新兴的优化技术,其难点在于证明算法能够收敛。本文是少数几篇对算法收敛有理论保证的论文之一。

该工作已经被人工智能顶级期刊IEEE Trans. Pattern Analysis and Machine Intelligence接收。

项目负责人:王立威

Distributed Bandit Learning: Near-Optimal Regret with Efficient Communication.

该工作提出了分布式求解bandit问题的高效算法。分布式bandit问题具体考虑多个agent以合作的方式求解同一个bandit问题,通过相互通信最小化这些agent总的损失。对于multi-armed bandit和linear bandit两种不同问题设定,相应的分布式 算法均达到了理论上可以达到的最小损失值,另一方面,算法的通信复杂度非常低,在理论上也有通信复杂度的保证。对于multi-armed bandit,可以证明,算法的通信复杂度接近理论上所需要的最小通信复杂度。

相关工作被机器学习领域顶级会议 ICLR2020 接收。

项目负责人:张长水

《基于密集对应关系的目标检测框架》

基于卷积神经网络的目标检测方法得到快速发展。然而当难以获取足够的标注数据时,强监督检测方法难以泛化。在某些数据难以获取或是紧急的任务中,如果我们仅有几个物体的模版,能否完成目标检测的任务?

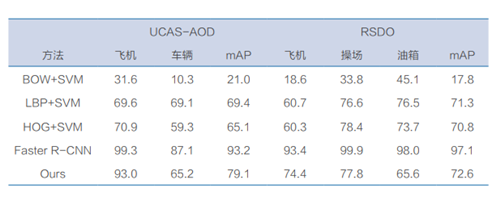

我们提出了一种基于密集对应关系的目标检测框架。该框架通过少量模版图像以及背景图像合成数据训练寻找对应关系的模型,并通过模版与真实图像块之间的对应关系估计出相似度,作为该类的置信度。由于模版匹配更适合类内变化较小的目标,而遥感目标检测中的目标大多满足这个要求。我们在遥感目标检测数据集UCAS-AOD和RSOD上做实验,被检测的对象包括飞机、车辆、操场以及油箱。我们采用目标检测中常用的指标平均精度(AP),结果见表格1。选取的对比方法为现有的强监督目标检测方法(BOW+SVM,LBP+SVM,HOG+SVM,Faster R-CNN),这些方法使用大量带有边框标注的训练数据,而我们的方法仅用了每类的9个模版。在这种情况下我们的方法仍然在平均精度上超过传统的非深度强监督方法,而与当前深度目标检测方法有一定差距。在一些与背景有较大形状和纹理差距的类别上,例如飞机,我们的方法远超过传统目标检测方法。

表格 1 不同方法在UCAS-AOD和RSOD数据集上的平均精度(%)结果

项目负责人:朱军

发表文章:Posterior sampling for multi-agent reinforcement learning: solving extensive games with imperfect information, 计算机决策是人工智能的重要任务。在复杂任务中,决策的环境往往是未知的,存在不确定性。智能体并非是在一开始就了解所有关于决策环境的参数,智能体需要通过和环境的交互学到关于这些参数的知识。在多智能体、环境参数未知的决策问题中,已有算法缺乏理论保证收敛到纳什均衡。为此,我们将博弈论与强化学习融合,提出了一种CFR-PSRL算法,通过设计一个新的交互策略,将汤普森后验分布采样算法扩展到了不完全信息扩展型博弈上,得到了第一个在该场景下理论上保证收敛到纳什均衡的算法。

该工作已被机器学习著名国际会议ICLR 2020录用为Oral文章,录取率<1.9%。

项目负责人:叶杰平

AutoCompress: An Automatic DNN Structured Pruning Framework for Ultra-High Compression Rates. AAAI 2020

近年来,随着深度神经网络模型性能不断刷新,模型的骨干网络参数量愈发庞大,存储和计算代价不断提高,从而导致难以部署在资源受限的嵌入式平台上。我们提出了一种基于AutoML思想的自动结构化剪枝的算法框AutoCompress,能自动化的去寻找深度模型剪枝中的超参数,去除模型中不同层的参数冗余,替代人工设计的过程并实现了超高的压缩倍率。从而满足嵌入式端上运行深度模型的实时性能需求。相较之前方法的局限性,该方法提出三点创新性设计:

(1) 提出混合型的结构化剪枝维度;

(2) 采用高效强大的神经网络剪枝算法ADMM(交替乘子优化算法)对训练过程中的CONFERENCE正则项进行动态更新;

(3) 利用了增强型引导启发式搜索的方式进行行为抽样。在CIFAR和ImageNet数据集的大量测试表明AutoCompress的效果显著超过各种神经网络压缩方法与框架。在相同准确率下,实际参数量的压缩相对之前方法最大可以提高超120倍。

该工作发表在机器学习顶级会议AAAI 2020.

相关人物