全球最强性能,北京人形开源天工“视觉语言大脑”

发布时间:2025-11-18

发布时间:2025-11-18

信息来源:北京亦庄微信公众号

字体:

大

中

小

信息来源:北京亦庄微信公众号

字体:

大

中

小

打印

打印

发布时间:2025-11-18

发布时间:2025-11-18

信息来源:北京亦庄微信公众号

信息来源:北京亦庄微信公众号

如何让人形机器人天工“长眼会动脑”的能力复制推广到更多机器人?11月13日,北京人形机器人创新中心全面开源具身智能VLM(视觉-语言)模型——Pelican-VL 1.0。该模型相当于人形机器人天工的“视觉语言大脑”,覆盖7B、72B参数规模,是迄今为止“最大规模的开源具身多模态大模型”,也是目前全球性能最强的具身智能VLM模型。

当前,实现“让机器人服务人类”这一目标,还面临具身智能体对“空间-时间”理解不足、多步骤长线程复杂决策能力缺失等挑战。在机器人典型的“视觉-语言-行动”系统里,Pelican-VL扮演着“视觉语言大脑”的角色,负责“看图听话”,让机器人理解指令和环境,使其能像人类一样将复杂任务拆解并落地操作。

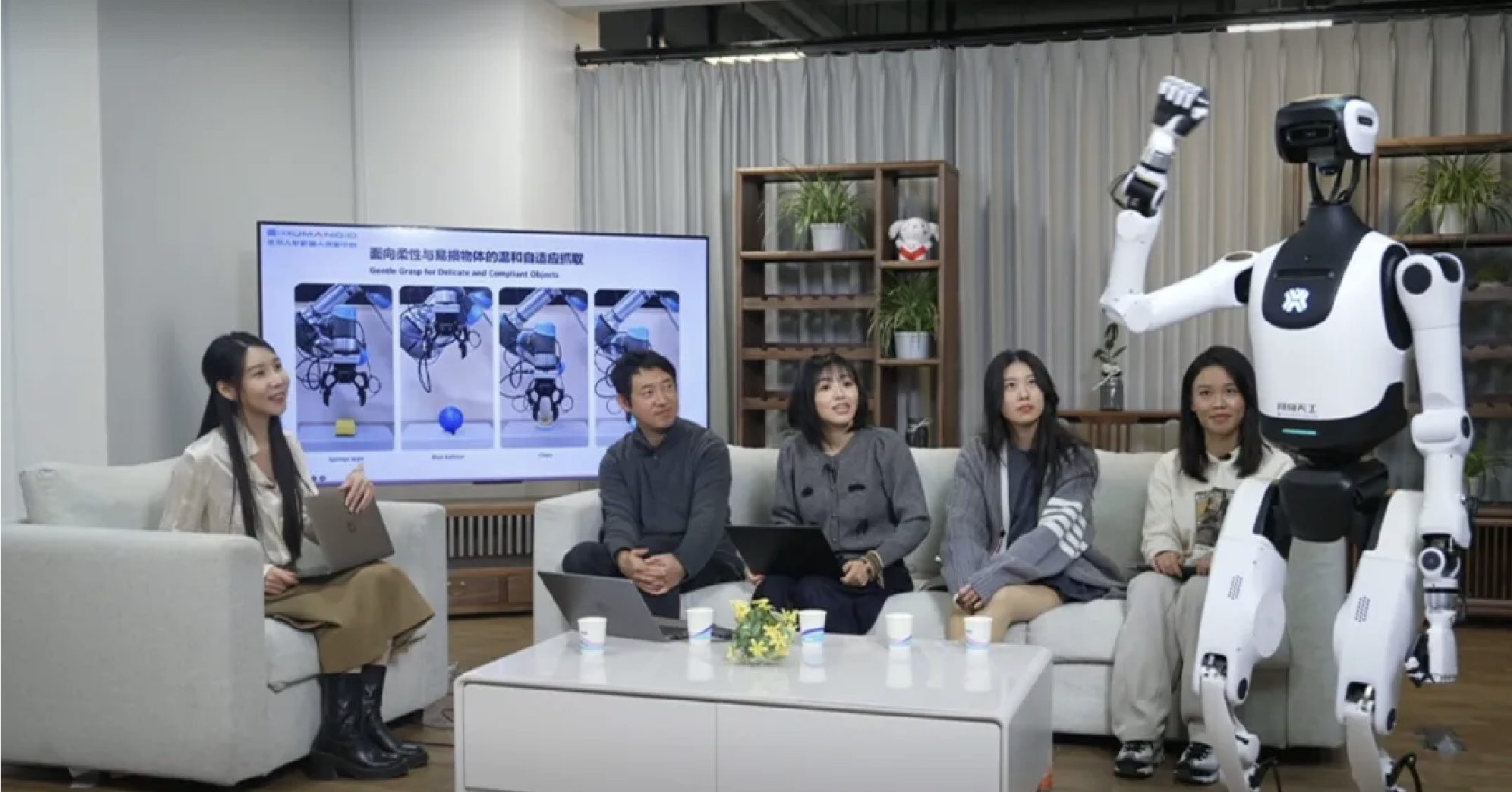

Pelican-VL发布现场。北京人形机器人创新中心/供图

“把鞋子放到鞋架上、将桌上的垃圾扔到垃圾桶,再把衣服放入洗衣机”——比如,当人类向天工发出这样一连串指令,Pelican-VL就能感知房间物体和布局,构建出整个环境的语义表示,然后根据指令自动生成行动序列,指挥机器人依次完成移动、抓取、放置等任务。

为了实现这一突破,Pelican-VL的核心主创团队提出一套全新的DPPO(刻意训练)训练范式,是全球首创的具身多模态大模型后训练自进化算法框架。该框架能让Pelican-VL像一名刻苦钻研的学生,每次训练循环都会“看视频—自主练习—发现错误—纠正提升”,并在这样的循环中不断自我纠错和迭代进步。这使得Pelican-VL仅用其他大模型的1/10甚至1/50的数据量,便实现“性能最强”的目标。

根据测试,Pelican-VL 1.0在具身智能领域的性能超越GPT-5同类模型15.79%,与Google gemini系列模型相比提升19.25%,成为目前最强的开源具身多模态大模型。

Pelican-VL 1.0的开源,不仅代表着北京人形机器人在具身智能领域的又一重大突破,也能帮助更多人形机器人更好的感知空间-时间、实现具身交互。作为具身智能的基础软件平台,Pelican-VL 1.0的开源将以“开放型大脑”的方式,让各厂商基于它快速开发特定场景下的应用方案,大大降低开发成本和难度。从商业服务、工业制造,到高危作业、家庭服务等多种真实场景,更多机器人将在其助力下具备灵活自适应、多步规划的能力。

北京人形机器人新中心于2023年11月在北京经开区成立以来,依托区内完善的研发场地、测试环境及产业配套支持,已打造了通用硬件平台“具身天工”和通用软件平台“慧思开物”,并基于此推动具身智能从“能跑”到“聪明和好用”的突破,在区内举办的全球首个人形机器人半程马拉松赛事中,北京人形机器人新中心“天工Ultra”人形机器人夺得冠军。此次Pelican-VL 1.0的开源,不仅是技术突破,也是生态布局的又一落子。随着政策与场景等协同推进,北京亦庄正赋能软硬协同攻关、二次开发等领域,加快推动具身智能机器人创新发展,抢占全球机器人产业制高点。

相关人物